Digital Twin einer Rechenzentrum-Infrastruktur mit Echtzeit-Betriebsdaten, interaktiv erfahrbar auf einem Large-Format-Display

Foto: © Ulrich Buckenlei | Visoric GmbH | Aufgenommen auf dem NVIDIA-Stand, CES Las Vegas 2026 | Redaktionelle Dokumentation

In der öffentlichen Diskussion über digitale Transformation dominieren häufig Schlagworte wie KI-Strategie, Datenplattformen oder Cloud-Migration. Doch während Technologieanbieter längst mit immersiven Visualisierungen, autonomen Systemen und Physical AI arbeiten, bleibt der strukturelle Umgang mit komplexen Echtzeitdaten in vielen Unternehmen weitgehend unverändert: Dashboards, Reports, zweidimensionale Screens.

Gleichzeitig zeigen aktuelle Studien, dass sich die Anforderungen an Entscheidungsgeschwindigkeit massiv verschieben. Laut McKinsey nutzen bereits 88 Prozent der Unternehmen KI in mindestens einer Geschäftsfunktion – doch nur ein Drittel hat begonnen, KI systematisch zu skalieren.[5] Deloitte belegt, dass 92 Prozent der Fertigungsverantwortlichen mindestens einen Metaverse-Usecase erproben und dabei 12 bis 14 Prozent Performance-Verbesserungen erwarten.[8]

Die eigentliche Frage lautet daher nicht, ob Spatial Computing im industriellen Kontext eingesetzt wird. Sie lautet: Verändert sich die Entscheidungslogik selbst?

Wenn Daten nicht mehr ausschließlich als Tabellen und statische Charts verfügbar sind, sondern als räumlich erfahrbare, physisch verortete Informationsschichten – direkt an der Maschine, im Produktionsprozess, in der Kollaboration – verschiebt sich der Engpass. Der Flaschenhals liegt dann nicht mehr primär im Zugang zu Daten, sondern in der Fähigkeit, Systeme in ihrer physischen Komplexität zu verstehen, Zusammenhänge räumlich einzuordnen und in Echtzeit zu handeln.

Was in der Forschung als Embodied Cognition beschrieben wird – dass physische Interaktion das Verständnis komplexer Systeme fundamental verbessert – findet in Spatial Computing seinen technologischen Ausdruck.[2] Das Dashboard wird zur räumlichen Steuerungsebene. KI strukturiert Entscheidungspfade. Digital Twins visualisieren komplexe Prozesse. Physical AI macht abstrakte Systemlogik greifbar.

Kosten verschwinden dabei nicht. Sie verändern ihre Struktur. Statt primär in Rechenzentrums-Infrastruktur zu investieren, rücken Interaktionskonzepte, Datenarchitektur, räumliches Interface-Design und die Integration physischer Systeme in den Mittelpunkt. Wettbewerbsvorteile entstehen nicht durch Datenmengen allein, sondern durch die Fähigkeit, Systeme sinnvoll zu orchestrieren.

Damit stellt sich eine zentrale Frage: Wie könnte industrielle Entscheidungsfindung aussehen, wenn Spatial Computing nicht als Zusatz, sondern als integraler Bestandteil einer neuen Entscheidungsarchitektur gedacht würde?

Räumliche Daten verändern Entscheidungen

Industrielle Entscheidungen scheitern heute selten an fehlenden Daten, sondern an der Herausforderung, komplexe Systemzusammenhänge verständlich und handlungsfähig zu machen. Während Daten jederzeit verfügbar sind, bleibt die Frage offen, wie Prozesse, Wechselwirkungen und Anomalien so aufbereitet werden können, dass echtes physisches Verständnis entsteht – und nicht nur Datenkonsumption.

Spatial Computing setzt genau hier an. Nicht, weil es Ingenieure oder Operatoren ersetzt, sondern weil es den Moment des Verstehens vorverlagert. Was bisher als abstraktes Chart erklärt wurde, kann als räumliches Modell, lebendiger Digital Twin oder physisch verortete Datenannotation direkt im Arbeitskontext erfahrbar werden. Der eigentliche Gewinn liegt nicht in spektakulärer Visualisierung, sondern in der Qualität der Entscheidungen pro Zeiteinheit.

- Früher Engpass: Datenverfügbarkeit und Reportinggeschwindigkeit bestimmen das Reaktionstempo

- Neuer Engpass: Modellqualität und räumliches Interaktionsdesign bestimmen die Tiefe des Systemverständnisses

- Neue Routine: Entscheidungsprozesse werden medienübergreifend gedacht

Von traditionellen Dashboards zum Spatial Digital Twin – Echtzeit-Daten werden räumlich erfahrbar und direkt handlungsleitend

Grafik: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung zeigt den strukturellen Shift von isolierter Datenanzeige über Data Integration hin zum Spatial Digital Twin als räumlicher Steuerungsebene | Die Abbildung dient der analytischen Einordnung

Die Grafik zeigt keine einzelne Technologie, sondern einen Prozess. Links das bekannte Muster: Menschen stehen vor Dashboards und konsumieren Daten. In der Mitte die Integrationsebene, Cloud und On-Premise Daten werden zusammengeführt, durch KI Analytics angereichert und in Echtzeit verfügbar gemacht. Rechts das Ziel: ein Spatial Digital Twin, in dem Teams gemeinsam räumliche Daten verstehen, analysieren und direkt handeln.

Nicht Charts konsumieren, sondern den Raum verstehen. Genau das ist der Kern des Shifts von reaktivem Reporting zu räumlich-kontextueller Entscheidungsfindung.

Sobald diese Ebene verfügbar ist, verschiebt sich der Fokus von Datenmengen hin zu Interaktionsqualität, räumlicher Kontextualisierung und strategischem Interface-Design. [1]

Im nächsten Kapitel wird analysiert, unter welchen Bedingungen diese mögliche Verschiebung in industriellen Entscheidungsprozessen tragfähig werden kann.

Nicht das Tool entscheidet sondern das System.

Viele Spatial-Computing-Projekte in Unternehmen beginnen mit einer naheliegenden Frage: Welche Geräte brauchen wir? AR-Brillen, VR-Headsets, Digital-Twin-Plattformen, Sensor-Infrastruktur. Die Technologieauswahl steht im Vordergrund. Doch genau hier liegt oft ein struktureller Denkfehler. Einzelne Tools verändern noch keine Entscheidungslogik. Sie ergänzen sie lediglich. [8]

Die entscheidende Frage lautet daher nicht: Welche Hardware ist aktuell? Sondern: Wie greifen alle Elemente als kohärentes System ineinander? [10]

Von fragmentierten Tools zur integrierten Systemarchitektur – Seamless Integration durch KI, Decision Architecture und verbundene Ebenen

Grafik: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung zeigt die strukturelle Verschiebung von isolierter Tool-Integration hin zu einer KI-gestützten, vernetzten Entscheidungsarchitektur mit Sensor, AR/VR und Robotic als verbundene Systemebenen | Die Abbildung dient der analytischen Einordnung.

Die linke Seite der Grafik zeigt ein bekanntes Muster. Einzelne Spatial-Computing-Tools werden eingeführt – oft nacheinander und unabhängig voneinander. AR für Wartung hier, VR-Training dort, ein Digital-Twin-Pilot in einem Werk. Jede Lösung erfüllt einen Zweck, doch sie bleibt isoliert. Das führt zu hoher Fragmentierung, parallelen Datensilos und steigenden Integrationskosten. [8]

Die Nutzenkurve in diesem Modell steigt zunächst schnell durch den Novelty-Effekt, flacht jedoch mit zunehmender Nutzung ab. Koordination, Schnittstellenpflege und Qualitätssicherung erzeugen zusätzlichen Aufwand. Der strategische Impact bleibt häufig hinter den Erwartungen zurück, da kein durchgängiges System entsteht.

Die rechte Seite der Grafik zeigt einen anderen Ansatz. Hier steht nicht das einzelne Tool im Mittelpunkt, sondern eine Architektur. [10]

Im Zentrum befindet sich eine orchestrierende Ebene – ein Digital Twin als lebendes Systemmodell, das verschiedene Datenquellen miteinander verbindet. Darüber kann eine KI-Schicht Entscheidungsoptionen strukturieren, Anomalien priorisieren und unterschiedliche Systeme synchronisieren. Darunter liegen Sensor-Infrastruktur, räumliche AR-Interfaces oder physische Robotiksysteme. [1][3]

- Der Digital Twin wird zur Steuerzentrale physischer Systemzustände

- KI übernimmt Mustererkennung, Priorisierung und Entscheidungsvorbereitung

- Inhalte und Prozesse werden modular und wiederverwendbar strukturiert

- Physical AI übersetzt Datenlogik in physisch erfahrbare Intervention

In diesem Modell entsteht eine andere Logik. Erkenntnisse können kontextualisiert, geteilt und in Echtzeit in Handlung übersetzt werden. Das System wird iterativ entwickelbar und auf weitere Standorte skalierbar. [12]

Die Grafik zeigt daher nicht nur einen technischen Unterschied, sondern eine strategische Verschiebung. Von isolierten Tools hin zu einer integrierten Entscheidungsinfrastruktur. [10]

Im nächsten Kapitel wird untersucht, welche organisatorischen und technischen Voraussetzungen erfüllt sein müssen, damit eine solche Architektur nicht nur machbar, sondern nachhaltig wirksam wird.

Organisatorische und technische Voraussetzungen

Technologie allein verändert noch keine Entscheidungskultur. Selbst die beste Architektur aus KI, räumlichen Interfaces und Digital Twins bleibt wirkungslos, wenn sie nicht in tragfähige Strukturen eingebettet ist. Nachhaltige Transformation beginnt deshalb nicht mit Hardware, sondern mit Governance, Datenstrategie und klarer strategischer Ausrichtung. [8][10]

Die zentrale Frage lautet: Unter welchen Bedingungen kann eine integrierte Spatial-Computing-Architektur langfristig wirksam werden?

Voraussetzungen für nachhaltige Entscheidungstransformation – Von Governance über Datenqualität bis zur skalierbaren Spatial-Computing-Infrastruktur

Grafik: Redaktionelle Analyse | Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung zeigt vier strukturelle Ebenen, die für eine nachhaltige Integration von Spatial Computing, Digital Twins und Physical AI in industriellen Entscheidungsprozessen entscheidend sind.

Die Grafik reduziert die Komplexität bewusst auf vier Kernbereiche.

1. Governance

Transformation benötigt strategische Planung. Ohne klare Zieldefinition, Daten-Ownership, Verantwortlichkeiten und Investitionsrahmen entstehen Pilotprojekte, aber keine nachhaltigen Systeme. Studien zur KI-Implementierung zeigen, dass fehlende Governance-Strukturen einer der häufigsten Gründe für das Scheitern von Transformationsinitiativen sind – 70 bis 85 Prozent der KI-Projekte verfehlen ihre erwarteten Ergebnisse. [6]

2. Datenqualität

Spatial Computing ist nur so gut wie die Daten, auf denen es operiert. Fehlende Sensorintegration, inkonsistente Datenmodelle oder mangelnde Echtzeit-Synchronisation zwischen physischem System und Digital Twin machen räumliche Visualisierung wertlos. Datenqualität ist keine technische Nebenbedingung – sie ist die Grundlage jeder sinnvollen Entscheidungsarchitektur. [1][3]

3. Human Expertise

Spatial Computing ersetzt keine Domänenexpertise. Ingenieure, Operatoren und Entscheider bleiben der zentrale Faktor. Ihre Rolle verschiebt sich jedoch – vom reaktiven Datenkonsumenten zum aktiven Systemgestalter. Damit das gelingt, sind gezielte Qualifizierung, kontinuierliche Begleitung und nutzerzentriertes Interface-Design notwendig. [2][12]

4. Skalierbare Infrastruktur

Technische Infrastruktur muss edge-fähig, latenzarm und standortübergreifend wartbar sein. Ein System, das nur im Pilotwerk funktioniert, erzeugt Frustration. Nachhaltigkeit bedeutet organisatorische Tragfähigkeit ebenso wie technische Stabilität und offene Schnittstellenstandards. [10]

Der Kern der Grafik liegt in ihrer Einfachheit. Sie zeigt, dass Entscheidungstransformation kein Technologieprojekt ist, sondern ein Strukturprojekt. KI, Spatial Computing und Physical AI sind Werkzeuge. Entscheidend ist das System, in das sie eingebettet werden.

Für Unternehmen, Industriebetriebe oder öffentliche Institutionen bedeutet das: Erfolgreiche Transformation entsteht nicht durch Einzelentscheidungen für Tools, sondern durch Architekturdenken. Wer nur Devices beschafft, modernisiert Oberfläche. Wer Strukturen entwickelt, verändert Wirkung.

Im nächsten Kapitel wird deshalb konkret untersucht, wie eine solche Entscheidungsarchitektur praktisch aufgebaut werden kann – von der ersten Analyse über Pilotphasen bis zur skalierbaren Implementierung.

Von der Analyse zur Skalierung

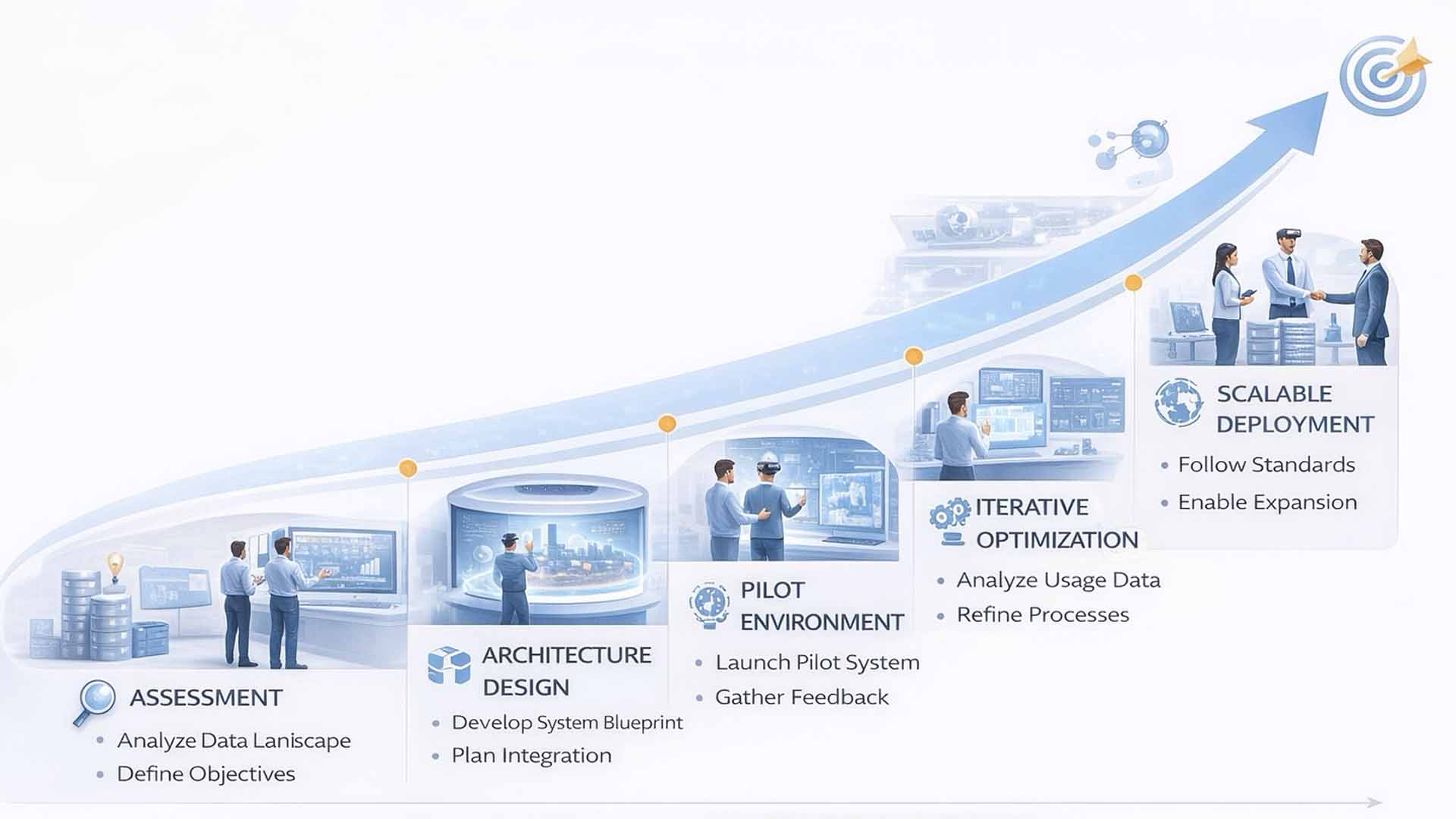

Die Einführung einer integrierten Spatial-Computing-Architektur ist kein Einzelprojekt. Sie ist ein strukturierter Entwicklungsprozess. Wer Digital Twins, räumliche Interfaces und Physical AI nachhaltig in Entscheidungsprozesse verankern möchte, braucht mehr als Begeisterung und Budget. Es braucht eine klar definierte Abfolge von Phasen, die aufeinander aufbauen und sich gegenseitig verstärken. [8][10]

Die folgende Grafik zeigt einen solchen Implementierungspfad – reduziert auf fünf zentrale Phasen. Jede Phase erfüllt eine spezifische Funktion im Reifeprozess einer Organisation.

Die Einführung einer integrierten Spatial-Computing-Architektur ist kein Einzelprojekt. Sie ist ein strukturierter Entwicklungsprozess. Wer Digital Twins, räumliche Interfaces und Physical AI nachhaltig in Entscheidungsprozesse verankern möchte, braucht mehr als Begeisterung und Budget. Es braucht eine klar definierte Abfolge von Phasen, die aufeinander aufbauen und sich gegenseitig verstärken. [8][10]

Die folgende Grafik zeigt einen solchen Implementierungspfad – reduziert auf fünf zentrale Phasen. Jede Phase erfüllt eine spezifische Funktion im Reifeprozess einer Organisation.

Implementierungspfad für skalierbare Entscheidungsarchitekturen – Von der Analyse über Pilotierung bis zur nachhaltigen Spatial-Computing-Struktur

Grafik: Redaktionelle Analyse | Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung zeigt fünf aufeinander aufbauende Phasen der Implementierung sowie die zunehmende Systemreife entlang der Zeitachse.

Die untere Kurve der Grafik verdeutlicht den zentralen Gedanken: Mit jeder Phase steigt die Systemreife. Transformation ist kein Sprung, sondern ein kontinuierlicher Reifeprozess.

Phase 1 – Assessment

Am Anfang steht keine Technologieentscheidung, sondern eine Analyse.

Hier werden bestehende Dateninfrastruktur, Entscheidungsprozesse, organisatorische Rahmenbedingungen und relevante Stakeholder systematisch erfasst. Welche Systeme existieren bereits? Wo liegen Medienbrüche in Entscheidungspfaden? Welche Domänenexpertise ist vorhanden? [8]

Ebenso wichtig ist die Definition von Wirkungszielen. Soll Reaktionszeit auf Anomalien verkürzt werden? Standortübergreifende Kollaboration verbessert? Wartungsintervalle präzisiert? Ohne klar definierte Ziele bleibt jede Architektur unscharf.

Assessment schafft Orientierung. Es verhindert technologiegetriebenen Aktionismus.

Phase 2 – Architecture Design

Erst nach der Analyse folgt die Systemarchitektur.

In dieser Phase entsteht ein technisches und prozessuales Blueprint. Welche Rolle spielt der Digital Twin? Wo wird Physical AI integriert? Welche Datenflüsse sind notwendig? Wie greifen Sensor-Layer, räumliche Interfaces und KI-Entscheidungsschichten ineinander? [10]

Hier entscheidet sich, ob ein Unternehmen einzelne Tools einführt – oder ein kohärentes Entscheidungssystem entwickelt.

Architecture Design bedeutet, Wechselwirkungen mitzudenken. Integration wird bewusst geplant, nicht zufällig erzeugt.

Phase 3 – Pilot Environment

Keine Transformation ohne Testfeld.

Im Pilotumfeld werden ausgewählte Prozesse, Werke oder Entscheidungsszenarien kontrolliert eingeführt. Operatoren und Entscheider erhalten gezielte Begleitung. Workflows werden beobachtet. Feedback wird strukturiert gesammelt. [2]

Pilotierung hat zwei Funktionen:

Sie reduziert Risiko.

Und sie schafft Erfahrungswissen, das kein Anbieter liefern kann.

Erst hier zeigt sich, wie Theorie in realen industriellen Kontexten funktioniert.

Phase 4 – Iterative Optimization

Transformation endet nicht mit dem ersten produktiven Einsatz.

In dieser Phase werden Nutzungsdaten ausgewertet, Operator-Feedback analysiert und Interface-Anpassungen vorgenommen. KI-Modelle werden feinjustiert. Visualisierungen werden vereinfacht. Datenstrukturen werden optimiert. [12]

Iteration ist kein Zeichen von Unsicherheit. Sie ist Zeichen professioneller Systementwicklung.

Die Grafik macht deutlich: Optimierung ist ein eigener, klar definierter Schritt – nicht ein Nebeneffekt des Betriebs.

Phase 5 – Scalable Deployment

Erst jetzt beginnt die eigentliche Skalierung.

Standards werden definiert. Governance-Modelle werden etabliert. Schnittstellenspezifikationen werden dokumentiert. Fortbildungsstrukturen für Operatoren und Entscheider werden institutionalisiert. [10]

Skalierung bedeutet nicht, ein Pilotprojekt zu kopieren. Es bedeutet, eine Architektur zu etablieren, die dauerhaft tragfähig und erweiterbar ist.

Die steigende Kurve in der Grafik symbolisiert genau diesen Reifegrad. Mit jeder Phase wird das System stabiler, integrierter und entscheidungswirksamer.

Der zentrale Unterschied liegt damit nicht in der Technologie, sondern im Vorgehen. Unternehmen, die strukturiert implementieren, entwickeln langfristige Systemkompetenz. Unternehmen, die isoliert pilotieren, erzeugen teure Insellösungen.

Und genau hier stellt sich die nächste, vielleicht entscheidendste Frage:

Wie verändert sich eigentlich die Rolle des Menschen innerhalb einer solchen Entscheidungsarchitektur?

Im nächsten Kapitel wird deshalb untersucht, wie sich das Berufsbild vom Datenkonsumenten zum Systemgestalter verschiebt – und warum diese Verschiebung der eigentliche Schlüssel zur Transformation ist.

Vom Datenkonsumenten zum Systemgestalter

Spatial Computing kann Prozesse visualisieren.

Es kann kontextualisieren, simulieren, antizipieren.

Aber es kann nicht urteilen.

Die eigentliche Transformation in industriellen Entscheidungsprozessen beginnt deshalb nicht bei KI, Digital Twins oder räumlichen Interfaces. Sie beginnt bei der Rolle des Menschen.

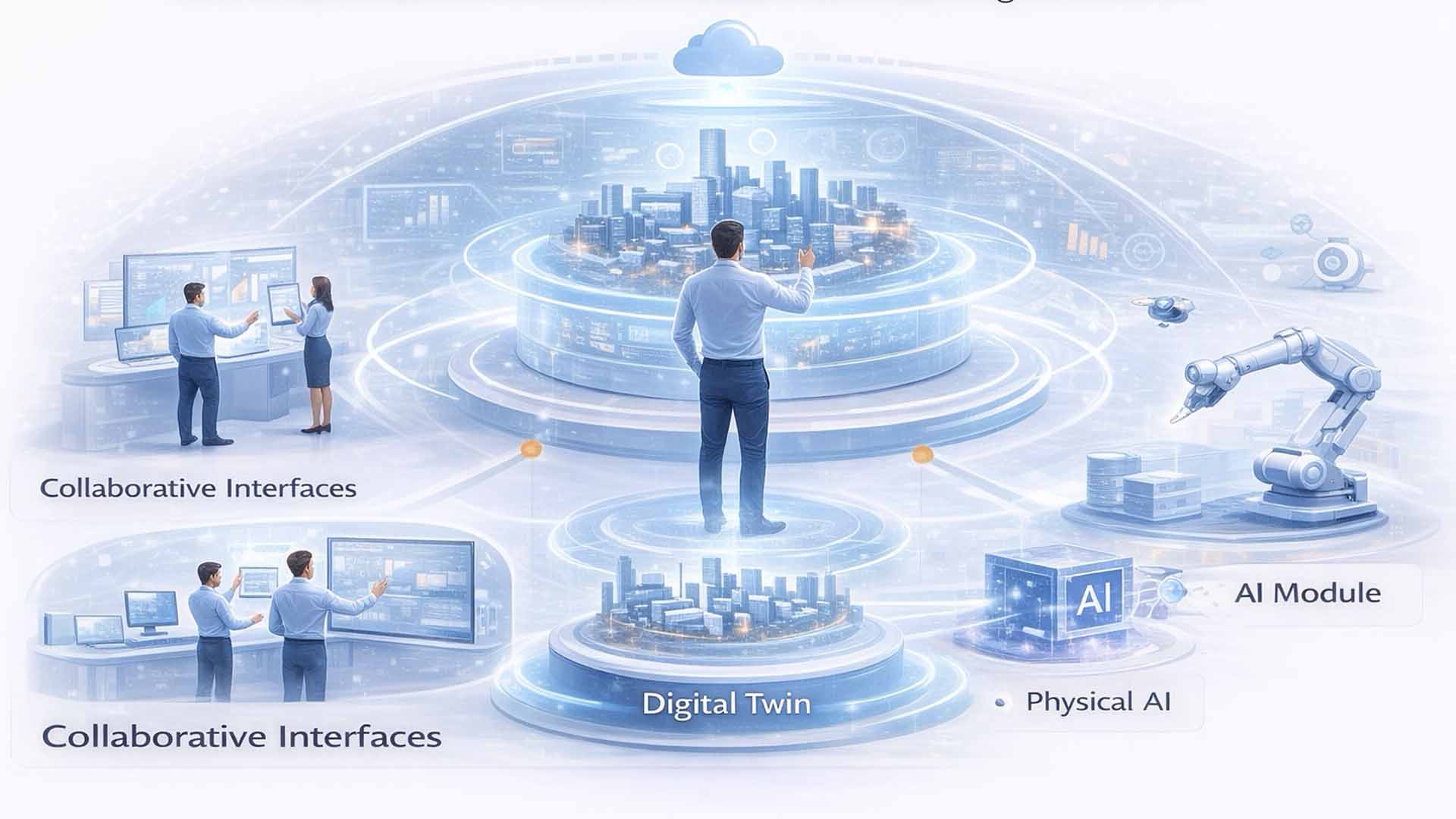

Der Mensch als Systemgestalter – Spatial Computing wird zum Werkzeug, der Experte bleibt Gestalter und Urteilszentrum

Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Redaktionelles Konzeptbild zur Verschiebung der Expertenrolle von der Datenkonsumption zur aktiven Gestaltung räumlicher Entscheidungsumgebungen.

Das Bild zeigt keine klassische Leitstand-Situation.

Der Entscheider steht nicht mehr isoliert vor einem Monitorwall. Er befindet sich im Zentrum einer dynamischen Entscheidungsumgebung. Digitale Zwillinge, ein KI-Modul, ein Physical-AI-System und kollaborative Interfaces kreisen visuell um ihn herum.

Doch entscheidend ist: Die Technologie dominiert nicht.

Sie ordnet sich.

Der Experte steuert, verbindet, bewertet, strukturiert. Die digitalen Systeme erweitern den Handlungsspielraum, ersetzen ihn aber nicht.

An den Interfaces arbeiten Kolleginnen und Kollegen aktiv – remote und vor Ort gleichzeitig. Sie interagieren mit Modellen, analysieren Anomalien, bewerten Szenarien, treffen Entscheidungen. Entscheidungsfindung wird sichtbar. Nicht als Konsumption von Reports, sondern als aktive Systeminteraktion.

Diese Darstellung verdeutlicht eine fundamentale Verschiebung.

Früher war industrielle Entscheidungsfindung häufig sequenziell organisiert:

Sensor → Daten → Report → Entscheidung.

In einer integrierten Spatial-Computing-Architektur entsteht ein anderes Muster:

Experte im Zentrum → orchestrierte Datenumgebung → aktive Systemintervention in Echtzeit.

Die Rolle verändert sich damit auf mehreren Ebenen:

Erstens wird der Experte zum Kurator. Er entscheidet, welche Daten, Modelle und Szenarien sinnvoll kombiniert werden.

Zweitens wird er zum Moderator. Er begleitet kollaborative Entscheidungsprozesse, stellt die richtigen Fragen, schafft Kontext.

Drittens wird er zum Architekten. Er gestaltet Entscheidungsräume bewusst und strategisch. [2][12]

Diese Verschiebung ist kein Verlust an Bedeutung. Im Gegenteil.

Je komplexer Systeme werden, desto wichtiger wird menschliches Urteilsvermögen. KI kann Muster erkennen. Sie kann Optionen vorschlagen. Doch Bedeutung, Kontextbewertung und strategische Feinsteuerung bleiben menschliche Kompetenzen.

Genau hier liegt der Schlüssel zur Transformation.

Wenn Unternehmen Spatial Computing einführen, ohne die Rolle der Entscheider weiterzuentwickeln, entsteht Überforderung. Wenn Experten jedoch als Gestalter einer erweiterten Entscheidungsumgebung verstanden werden, entsteht Empowerment.

Das Bild wirkt deshalb bewusst dynamisch und menschzentriert. Es zeigt kein technisches System. Es zeigt eine Haltung.

Und damit stellt sich die nächste zentrale Frage:

Wie kann diese neue Rolle konkret unterstützt, qualifiziert und strukturell verankert werden, sodass sie nicht von individueller Technologieaffinität abhängt, sondern systematisch gefördert wird?

Im nächsten Kapitel geht es daher um Befähigung, Change Management und strukturelle Begleitung – und darum, wie Transformation langfristig in der Praxis verankert werden kann.

Wie Transformation langfristig verankert wird

Spatial-Computing-Architekturen entstehen nicht allein durch Technologie. Sie entstehen durch Menschen, die sie verstehen, gestalten und kontinuierlich weiterentwickeln. Genau hier entscheidet sich, ob eine strategische Vision zur nachhaltigen Praxis wird – oder bei einem Piloten stehen bleibt.

Die folgende Visualisierung zeigt, dass professionelle Befähigung nicht auf einer einzelnen Ebene stattfindet, sondern systematisch über mehrere Ebenen hinweg gedacht werden muss.

Professional Enablement Model for Spatial Transformation – Vier aufeinander aufbauende Befähigungsebenen für nachhaltige Entscheidungsarchitektur

Konzeptgrafik: Mehrstufiges Befähigungsmodell zur nachhaltigen Verankerung von Spatial Computing, Digital Twins und Physical AI in industriellen Entscheidungsstrukturen | Visualisierung: Redaktionelles Modell | © Visoric GmbH

Die Grafik strukturiert Transformation in vier aufeinander aufbauende Ebenen. Jede Ebene ist notwendig. Keine kann isoliert funktionieren.

1. Individual Level – Kompetenz beginnt beim Menschen

Auf individueller Ebene geht es um grundlegende Fähigkeiten, die den sicheren und reflektierten Umgang mit Spatial-Computing-Systemen ermöglichen.

- Technische Skills – sicherer Umgang mit räumlichen Interfaces und Digital-Twin-Werkzeugen

- Analytische Skills – kontextbewusste Interpretation von KI-generierten Entscheidungsoptionen

- Reflexion und Adaptation – kontinuierliche Anpassung an sich weiterentwickelnde Systemumgebungen

Transformation bedeutet hier nicht, dass jeder Operator zum Datenwissenschaftler wird. Entscheidend ist die Fähigkeit, räumliche Systeme bewusst einzusetzen und ihre Entscheidungsunterstützung kritisch zu bewerten. Ohne diese persönliche Sicherheit entsteht Ablehnung – und Ablehnung blockiert Innovation.

2. Team Level – Entscheiden als kollektiver Prozess

Einzelne technologieaffine Personen reichen nicht aus. Nachhaltige Veränderung entsteht erst, wenn Teams gemeinsam arbeiten und voneinander lernen.

- Gemeinsame Szenario-Reviews in kollaborativen Digital-Twin-Umgebungen

- Kollaborative Entscheidungsformate über Standortgrenzen hinweg

- Community of Practice als dauerhafte Austauschstruktur für Best Practices

Erst wenn Erfahrungen geteilt, Entscheidungsszenarien gemeinsam reflektiert und Systemarchitekturen kooperativ weiterentwickelt werden, wird Innovation zur Norm. Andernfalls bleiben neue Methoden isolierte Experimente.

3. Institutional Level – Struktur schafft Stabilität

Selbst engagierte Teams stoßen an Grenzen, wenn organisatorische Rahmenbedingungen fehlen. Nachhaltige Transformation braucht strukturelle Absicherung.

- Capacity Planning – dedizierte Zeit und Ressourcen für System-Weiterentwicklung

- Dedicated Roles – klar definierte Verantwortlichkeiten für Spatial-Computing-Architektur

- Resource Allocation – finanzielle und organisatorische Absicherung jenseits des Piloten

Transformation darf nicht vom Engagement einzelner Technologie-Enthusiasten abhängen. Sie muss institutionell verankert sein. Erst dann entsteht Stabilität.

4. System Level – Nachhaltigkeit durch Governance

Die oberste Ebene betrachtet die Unternehmensarchitektur als Ganzes. Hier entscheidet sich, ob Veränderung strategisch abgesichert wird.

- Strukturierte Evaluation und kontinuierliche Wirkungsmessung der Architektur

- Langfristige strategische Verpflichtung jenseits einzelner Projektbudgets

Digitale Transformation ist kein Projekt mit Enddatum. Sie ist ein Entwicklungsprozess. Und dieser Prozess benötigt klare Governance-Strukturen, die unabhängig von Technologietrends Bestand haben.

Gesamtkonklusion – Warum dieses Modell entscheidend ist

Die Visualisierung macht deutlich, dass Transformation nicht durch Devices oder Plattformen definiert wird. Sie entsteht durch ein abgestimmtes Zusammenspiel von individueller Kompetenz, kollektiver Zusammenarbeit, institutioneller Struktur und systemischer Verankerung.

Technologie kann Prozesse ermöglichen.

Architektur kann Entscheidungsräume neu ordnen.

Doch Befähigung entscheidet, ob Veränderung dauerhaft wirkt.

Erst wenn alle vier Ebenen zusammenspielen, entsteht eine Entscheidungsarchitektur, die sich weiterentwickeln kann – unabhängig von einzelnen Tools oder Markttrends.

Im abschließenden Video wird diese Argumentation noch einmal verdichtet. Dort wird gezeigt, wie Spatial Computing, Digital Twins und Physical AI nicht isoliert betrachtet werden sollten, sondern als Teil einer neuen Entscheidungsarchitektur, die Technologie, Struktur und menschliche Expertise miteinander verbindet.

Das Video fasst die Kerngedanken zusammen und stellt die zentrale Frage:

Wenn diese Technologien bereits Industrie und Wirtschaft fundamental verändern – wie bewusst gestalten wir ihre Rolle in unseren Entscheidungsstrukturen?

Videoanalyse – Wenn Mixed Reality zur Physik wird

Das folgende Video zeigt keine abstrakte Zukunftsvision. Es zeigt etwas, das man anfassen kann.

Ein Display, eingebettet in eine physische Oberfläche, führt in Echtzeit eine Fluidsimulation aus, die direkt auf menschliche Berührung reagiert. Jede Interaktion injiziert Energie in ein simuliertes Feld, in dem Geschwindigkeit, Druck und Richtung live berechnet werden. Bewegung wird zu sofort sichtbarem Verhalten.

Was hier passiert, ist mehr als Visualisierung. Es ist interaktive Physik.[2]

Nutzer drücken keine Knöpfe. Sie interagieren mit Kräften, Strömungen und Verhalten. Physikalische Prinzipien werden zum Steuerungssystem selbst. Input, Simulation und Visualisierung laufen kontinuierlich. GPU-basierte Solver aktualisieren tausende Partikel pro Frame und erzeugen unmittelbares Feedback.[1]

Das Interface existiert im physischen Raum. Nutzer nehmen Struktur, Tiefe und Bewegung direkt wahr, statt flache Grafiken zu interpretieren. Genau das ist der Kern von Spatial Computing: Daten werden nicht gelesen, sondern erfahren.[3]

Von industrieller Simulation über medizinisches Training bis zu interaktiven Lernumgebungen zeigt dieses Beispiel, wie komplexe Systeme intuitiv werden, sobald sie physisch erkundbar sind.

Mixed Reality wird Physik – Echtzeit-Fluidsimulation reagiert auf Berührung und macht komplexe Systemdynamik direkt erfahrbar

Demonstrationsumgebung: Echtzeit-Fluidsimulation mit physischer Interaktion |

Analytische Einordnung: Ulrich Buckenlei |

Credits: 11d.agency x thirdroom AVL | Built with TouchDesigner

Dieses Beispiel steht exemplarisch für das Potenzial räumlicher Daten. Es ersetzt keine bestehenden Systeme. Es zeigt, was möglich wird, wenn Daten den zweidimensionalen Bildschirm verlassen und in den physischen Raum eintreten.

Wenn Spatial Computing bereits heute solche Erfahrungen ermöglicht, stellt sich die Frage nicht mehr ob Unternehmen darauf reagieren sollten, sondern wie bewusst und strukturiert diese Integration gestaltet wird.

Im abschließenden Kapitel wird diese Perspektive zusammengeführt und in einen strategischen Gesamtkontext eingeordnet, mit Blick auf Unternehmen und Organisationen, die Transformation aktiv gestalten wollen.

Quellen und Referenzen

- Zheng, M., Lillis, D. & Campbell, A.G., „Augmented Reality Data Visualization to Support Decision-Making“, Visual Informatics, Vol. 8, 2024, S. 80–105.

Systematische Review zur AR-gestützten Entscheidungsunterstützung: Taxonomie von AR-Visualisierungsstrategien und deren Wirkung auf Entscheidungseffizienz und kontextuelles Verständnis. [1] - Renata, A., Guarese, R., Takac, M. & Zambetta, F., „Assessment of Embodied Visuospatial Perspective Taking in Augmented Reality“, Frontiers in Virtual Reality, Vol. 5:1422467, 2024.

Peer-reviewed Studie zu Embodied Cognition in AR: Physische Interaktion mit virtuellen 3D-Objekten verbessert das Systemverständnis fundamental gegenüber 2D-Darstellungen. [2] - Chheang, V. et al., „Enabling Additive Manufacturing Part Inspection of Digital Twins via Collaborative Virtual Reality“, Nature Scientific Reports, 2024.

Nachweis, dass kollaborative VR-Inspektion von Digital Twins zu schnellerer Fehlererkennungsrate und besserer Teamkollaboration führt als klassische 2D-Ansichten. [3] - Baratta, A., Cimino, A., Longo, F. & Nicoletti, L., „Digital Twin for Human–Robot Collaboration Enhancement in Manufacturing Systems“, Computers & Industrial Engineering, Vol. 187, 2024, 109764.

Systematische Review zu Digital-Twin-gestützter Human-Robot Collaboration: Verbesserungen in Zykluszeit, Ergonomie und Bedienzufriedenheit dokumentiert. [4] - McKinsey & Company, „The State of AI in 2025“, McKinsey Global Survey, 2025.

88 Prozent der Unternehmen nutzen KI in mindestens einer Funktion; nur ein Drittel hat systematisch skaliert. Erfolgsfaktoren: Governance, Workflow-Redesign, menschliche Kompetenz. [5] - Fullview.io / MIT / RAND Corporation, „200+ AI Statistics and Trends for 2025“, 2025.

70–85 Prozent aller KI-Projekte verfehlen Ergebnisziele. Datenqualität und Governance als entscheidende Erfolgsfaktoren. [6] - Classic Informatics, „AI Development Statistics 2025“, 2025.

Edge AI Marktprognose: 66,47 Mrd. USD bis 2030 (CAGR 21,7 %). Lokale Datenverarbeitung ohne Cloud-Latenz als zentraler Treiber. [7] - Deloitte Insights, „Tech Trends 2024 – Spatial Computing and the Industrial Metaverse“, 2024.

92 Prozent der Fertigungsverantwortlichen erproben Metaverse-Usecases; 12–14 Prozent Performance-Verbesserung erwartet. Marktprognose Spatial Computing: 600 Mrd. USD bis 2032. [8] - Deloitte Consulting Central Europe, „Spatial Computing: The Future of Business Innovation“, 2025.

XR und Spatial Computing ermöglichen Echtzeit-Entscheidungsunterstützung durch räumliche Datenkontextualisierung. [9] - McKinsey & Company, „Technology Trends Outlook 2024“, 2024.

Digital Twins, immersive Technologien und KI als konvergente Megatrends mit exponentiell wachsender Enterprise-Adoption. [10] - Benton, K. Jr. et al., „Mixed Reality Digital Twin Environments for Human-Robot Collaboration“, Procedia Computer Science, Elsevier, 2024.

Framework für MR-Digital-Twins in der Fertigung; Nachweis der Machbarkeit räumlich-physischer Interaktion mit digitalen Zwillingen. [11] - PwC, „The Effectiveness of Virtual Reality Soft Skills Training in the Enterprise“, PwC US Research, 2020, aktualisiert 2024.

VR-Training ist ab 3.000 Lernenden 52 Prozent kosteneffizienter als Klassenraum; 275 Prozent höhere Anwendungszuversicht. [12] - Rupp, M. et al., „VR for Monitoring Additive Manufacturing Processes“, RWTH Aachen VR Lab, 2024.

VR-basiertes Echtzeit-Monitoring von Fertigungsprozessen: Anomalieerkennung signifikant schneller als bei klassischen Dashboard-Ansätzen. [13]

Transformation gestalten heißt, Verantwortung übernehmen

Die Integration von Spatial Computing, Digital Twins und Physical AI in industrielle Entscheidungsprozesse ist keine Frage einzelner Tools. Sie ist eine strukturelle Entscheidung. Sobald Entscheidungsarchitekturen räumlich erweitert werden, verändern sich Rollenbilder, Prozesslogiken und Anforderungen an Datenqualität, Governance und Change Management.

Die entscheidende Frage lautet daher nicht, ob die Technologie verfügbar ist. Entscheidend ist, wie sie sinnvoll eingebettet wird. Welche Entscheidungsprozesse sollen verbessert werden. Welche Systemzusammenhänge müssen räumlich erfahrbar werden. Welche organisatorischen Voraussetzungen müssen geschaffen werden. Und wie entsteht daraus ein nachhaltiger Wettbewerbsvorteil für Unternehmen, Teams und Institutionen.

Wer industrielle Entscheidungsprozesse neu denken möchte, braucht mehr als Hardware oder Plattformlizenzen. Es braucht eine saubere End-to-End-Betrachtung. Von der Analyse geeigneter Einsatzszenarien über die Konzeption einer tragfähigen Entscheidungsarchitektur, die Bewertung technologischer Optionen, die Definition organisatorischer Rollen bis hin zur strukturierten Pilotierung und Wirkungsmessung.

Genau an dieser Schnittstelle arbeiten wir als interdisziplinäres Expertenteam in München. Wir begleiten Industrieunternehmen, Systemintegratoren und öffentliche Institutionen bei der strategischen Einordnung von Spatial Computing und Physical AI. Wir entwickeln tragfähige Konzepte für digitale Entscheidungsarchitekturen, prüfen Machbarkeit und Wirkung und unterstützen bei der Umsetzung – nicht als isolierte Showcases, sondern als belastbare Strukturen.

Interdisziplinäre Konzeptarbeit – Analyse, Architektur und strategische Begleitung von Spatial-Computing-Transformation

Quelle: VISORIC GmbH | München

- Strategische Analyse → Bewertung von Potenzialen und realistischen Einsatzszenarien für Spatial Computing

- Architekturentwicklung → Konzeption integrierter Digital-Twin- und Entscheidungsmodelle

- Pilotierung → Strukturierte Erprobung unter realen industriellen Bedingungen

- Evaluation → Messung von Wirkung, Nutzerakzeptanz und Skalierbarkeit

- Organisationsentwicklung → Rollen, Prozesse und Governance-Strukturen für nachhaltige Verankerung

- Langfristige Begleitung → Nachhaltige Integration in bestehende Systemlandschaften und Entscheidungskulturen

Wenn Sie prüfen möchten, wie sich Entscheidungsprozesse, operative Abläufe oder industrielle Kollaborationsstrukturen durch Spatial Computing strukturiert weiterentwickeln lassen, lohnt sich ein gemeinsamer Blick auf Ihre Ausgangssituation.

Nicht als Verkaufspräsentation, sondern als analytisches Gespräch darüber, wo räumliche Entscheidungsunterstützung operativ sinnvoll, technisch tragfähig und langfristig wirksam ist.

Transformation beginnt nicht mit Technologie.

Sie beginnt mit einer klaren Architektur – und mit der Bereitschaft, sie bewusst zu gestalten.

Kontaktieren Sie uns:

E-Mail: info@xrstager.com

Telefon: +49 89 21552678

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@xrstager.com

Nataliya Daniltseva (Projektleiterin)

Mobil: +49 176 72805705

E-Mail: nataliya.daniltseva@xrstager.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München