KI-gestützte Basketballanalyse ohne Sensoren

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

Links & Ressourcen

- Github-Repo: https://github.com/abd…

- Basketball Detection Dataset: https://universe.roboflow.com/…

- Zero Shot Classifier: https://huggingface.co/…

- Basketball Court Keypoint Dataset: https://universe.roboflow.com/…

- YouTube-Video: KI/ML-System zur Basketballanalyse entwickeln

Was wäre, wenn man ein Spiel analysieren könnte – ganz ohne Sensoren?

Stell dir vor, man verfolgt Spielerbewegungen, analysiert Ballbesitz, berechnet Teamstatistiken und Laufgeschwindigkeiten – ganz ohne einen einzigen Chip. Dieses KI/ML-Projekt zeigt, wie das möglich ist: Nur mit Video und Computervision.

Ursprünglich entwickelt von Code In a Jiffy, nutzt dieses Open-Source-Framework YOLO, OpenCV und Python zur Erkennung von Spielern, Bällen, Teams, Pässen, Keypoints und Distanzen – alles in Echtzeit. Ein Showcase für KI pur.

Echtzeit-Erkennung von Spielern und Schiedsrichtern per YOLO

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

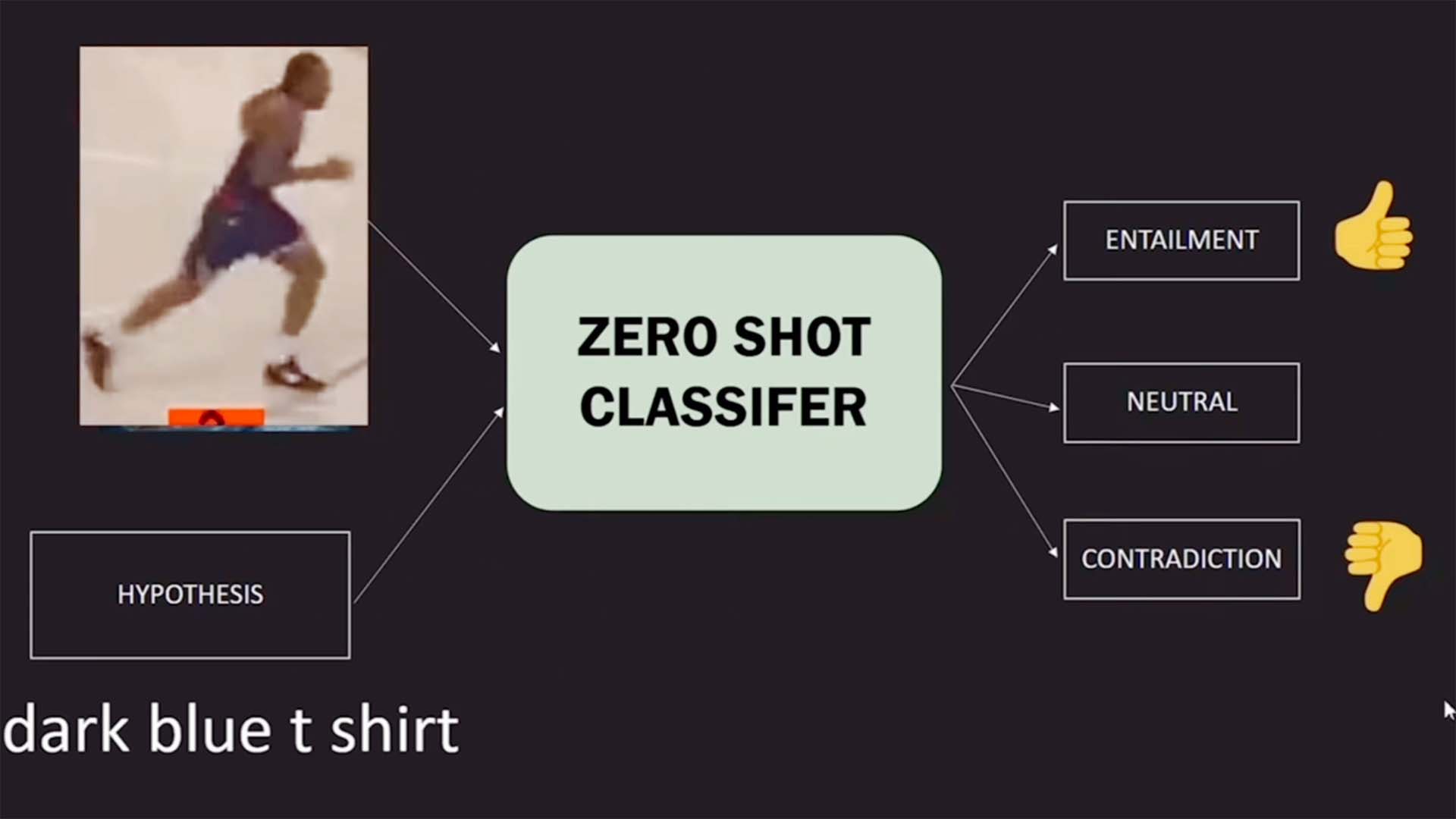

Zero-Shot-Klassifikation: So erkennt KI Trikotfarben

Zur Unterscheidung der Teams wurde ein Zero-Shot-Bildklassifikator verwendet. Anstatt das Modell mit allen Trikots zu trainieren, genügen Text-Prompts wie „dunkelblaues T-Shirt“, um Teams dynamisch zu erkennen.

Das bringt enorme Flexibilität. Neue Outfits? Kein Problem. Der Klassifikator passt sich anhand von Beschreibungen an – möglich durch HuggingFace’s NLI-Modelle. Das spart Zeit und erhöht die Skalierbarkeit.

Team-Erkennung per Zero-Shot-Bildklassifikation

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

Das Spielfeld verstehen: Keypoints und Layout

Was passiert wo? Um das zu beantworten, lernt das System das Layout des Spielfelds durch Keypoint-Erkennung. Ein eigens trainiertes Modell erkennt Körbe, Ecken und Zonen – aus jedem Blickwinkel.

So lassen sich alle Aktionen präzise im Raum verorten. In Kombination mit Perspektivkorrektur wird das Datenmodell vollständig räumlich – ein entscheidender Schritt für Taktikanalysen und Leistungsmetriken.

Erkennung von Feldpositionen anhand visueller Landmarken

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

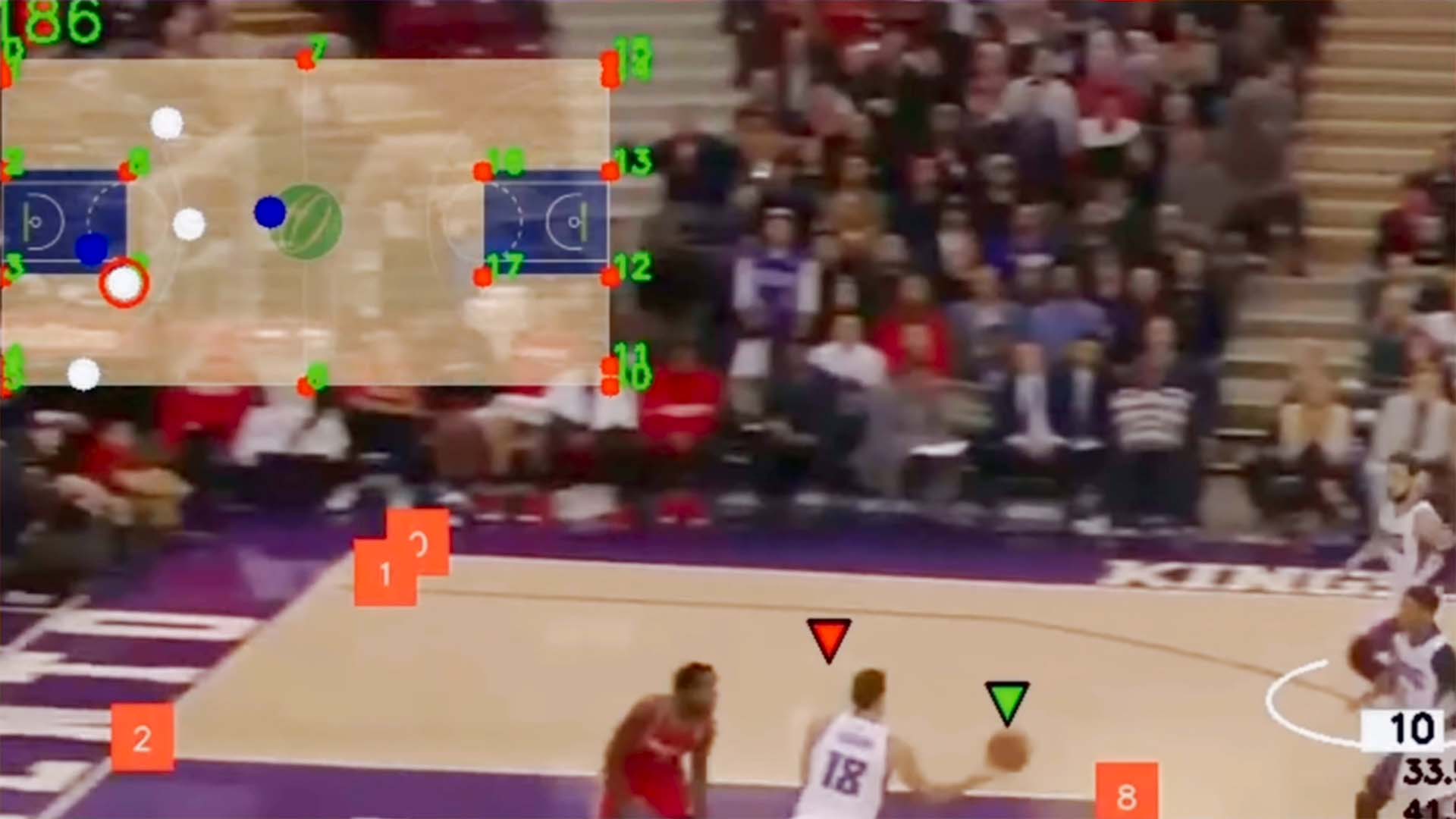

Vom Video zur taktischen Vogelperspektive

Sobald das Spielfeld erkannt ist, wird die Kameraperspektive transformiert. Mit Hilfe der Perspektivabbildung wird das Bild in eine Draufsicht umgewandelt – und damit zur taktischen Analyse nutzbar.

Jetzt sieht man Pässe, Bewegungen, Formationen und Lücken in der Verteidigung – genau wie in professionellen Dashboards. Nur dass alles per KI aus dem Video generiert wird.

Perspektiv-Transformation für spielanalytische Draufsichten

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

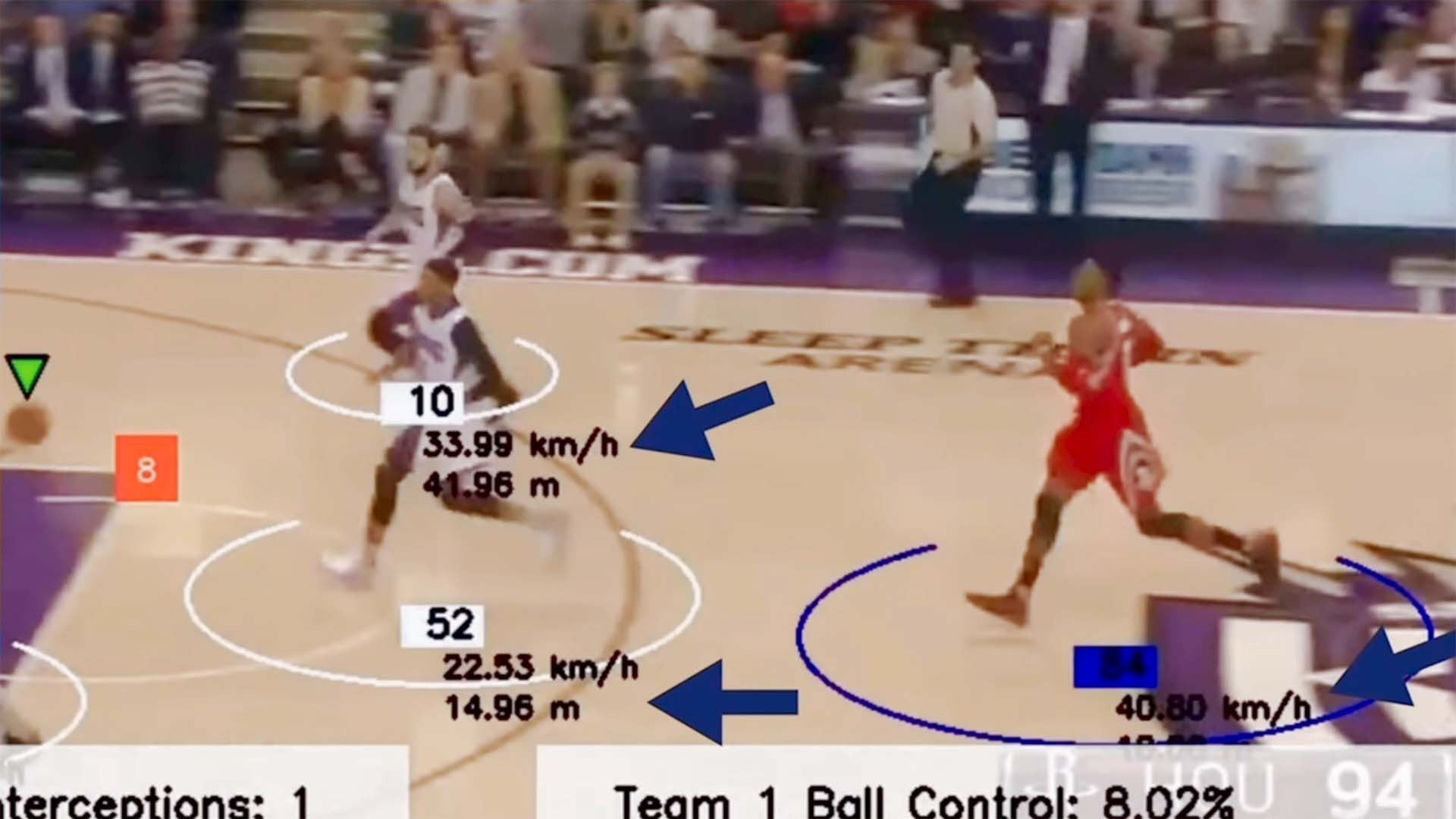

Geschwindigkeit, Distanz, Leistung: In Metern statt Pixel

Wie schnell ist jeder Spieler? Wie weit ist er gelaufen? Das System berechnet reale Werte, indem es Pixelbewegung in Spielfeldkoordinaten umrechnet – ermöglicht durch KI und Geometrie.

So erhalten Trainer, Analysten und Fans Profi-Statistiken – ganz ohne Wearables, nur durch die Analyse der Aufnahmen mit den passenden Modellen.

Bewegungsanalyse mit echten Spielfeldmetriken

Bild: © Code in a Jiffy | Visuals überarbeitet von Ulrich Buckenlei – Visoric GmbH

Video: KI-gestützte Basketball-Analyse in Aktion

Sieh dir die komplette Analyse in Bewegung an – vom Rohmaterial bis zum Dashboard. Das Video führt dich Schritt für Schritt durch das Projekt – inklusive Live-Ergebnisse.

Wer Sport-KI entwickelt oder Sensoren durch Vision ersetzen möchte: Dieses Projekt ist die perfekte Vorlage. Kompakt, elegant, Open Source.

Kompletter KI-Workflow vom Court-Video zur Taktik-Auswertung

Video: © Code in a Jiffy | Schnitt: Ulrich Buckenlei – Visoric GmbH

Entwickle dein eigenes Vision-AI-System

Dieses Projekt eignet sich ideal für eigene Experimente – eine perfekte Basis für sensorlose Tracking-Systeme. Egal ob im Einzelhandel, im Sport oder in der Logistik: Vision AI bringt echte Einsichten.

Visoric unterstützt Unternehmen bei der Entwicklung individueller KI-Analysetools – von der Idee bis zur Umsetzung. Wenn dich das inspiriert hat, melde dich.

- Vision-KI-Prototyping: Individuelle YOLO- & OpenCV-Pipelines

- Tracking ohne Sensoren: Reale Erkennung nur aus Video

- Deployment-Unterstützung: Für Sport, Handel, Industrie und mehr

Lass uns gemeinsam Visionäres entwickeln.

Kontaktieren Sie uns:

E-Mail: info@xrstager.com

Telefon: +49 89 21552678

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@xrstager.com

Nataliya Daniltseva (Projektleiterin)

Mobil: +49 176 72805705

E-Mail: nataliya.daniltseva@xrstager.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München